System Messages

- FUENTE: Juventud Rebelde

- 22 Marzo 2022

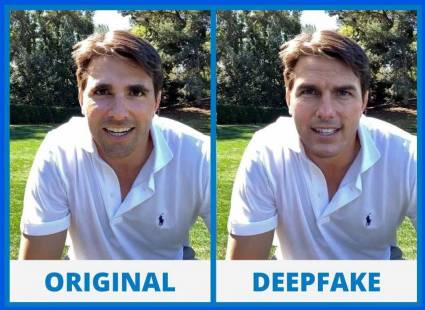

Tras realizar varios experimento con retratos ficticios, generados por inteligencia artificial (IA), un grupo de investigadores ha llegado a la conclusión de que “cazamos" las imágenes falsas menos de la mitad de las veces.

Sus experimentos demuestran que solo acertamos en el 48,2% de las ocasiones, lo que significa que —al menos desde un punto de vista teórico y de pura estadística— tendríamos más probabilidades de dar en el clavo si nos lo jugásemos a cara y cruz y lanzásemos una moneda al aire.

Para su estudio, publicado en Proceedings of the National Academy of Sciences, los investigadores realizaron varios experimentos con 800 imágenes, todas retratos de personas con fondos neutros. Algunas eran reales, otras sintéticas, elaboradas por StyleGAN2, un algoritmo de IA presentado por Nvidia hace un par de años. Durante su primer análisis se pidió a 315 personas que observasen 128 fotos y valorasen si eran reales o deepfakes. ¿El resultado? De media, acertaron el 48,2% de las veces, muy cerca, reconocen, de lo que se conseguiría por pura suerte.

En una segunda prueba los científicos cambiaron ligeramente las reglas de juego: se dio a los participantes algunas nociones de cómo identificar un rostro falso y se les informó, después de cada análisis, de si habían acertado o no. Con esa ayuda extra, su puntería subió al 59%. Eso sí, a los observadores les fue mejor en la primera mitad del experimento que en la segunda.

Más allá de las veces que detectamos un deepfake, el experimento deja algunas conclusiones curiosas. Las observaciones revelan, por ejemplo, que nos resulta más difícil acertar cuando lo que tenemos delante es un rostro blanco. No es casualidad. Como apuntan los investigadores, la razón es probablemente que la base de datos con la que se entrena StyleGAN2 cuenta con mayor número de fotografías de caucásicos, lo que le permite generar imágenes "más realistas".

Otra cuestión interesante es cómo de fiables nos resultan los rostros elaborados con inteligencia artificial. ¿Nos transmiten una sensación de seguridad? Y si es así, ¿Es esta mayor que la que nos suscitan las caras de personas de carne y hueso? Para salir de dudas los científicos pidieron a 223 personas que calificaran la "confiabilidad" de 128 retratos, todos tomados de la base de 800 imágenes del experimento. Luego les pidieron que las evaluasen del uno al siete.

Por término medio, los rostros reales recibieron una puntuación de 4,48 y los deepfakes, 4,82. Es más, las cuatro caras que levantaban más sospechas durante el experimento eran reales y las tres mejor paradas, sintéticas, fruto de StyleGAN2.

Con los datos sobre la mesa, los científicos alertan de los graves riesgos de los deepfakes. "Los rostros generados sintéticamente no solo son fotorrealistas, sino que son casi indistinguibles de los rostros reales y se consideran más confiables", precisan. Aunque ese nivel de fidelidad es sin duda un "éxito para el campo de la infografía", en otras áreas creen que puede resultar más polémica.

Desde luego no son los primeros en advertir de los riesgos de los deepfakes. Las imágenes y grabaciones generadas por IA se usan ya para cometer fraudes, engaños o vulnerar la intimidad de las personas falseando vídeos y fotos con los que luego se crean piezas con un claro contenido sexual. Afecta a los particulares, pero también, subrayan los expertos, a las democracias.

(Con información de Xataka.com)

Enviar un comentario nuevo